ブログ

AIエージェントの法的留意点 民事責任① 補助・支援型について ―経産省「AI利活用における民事責任の手引き(案)」の裁判実務を踏まえた検討―

2026.03.10

はじめに

第5回(前回)のブログでは、AIエージェントの「AIガバナンス」について、その必要性と実践的な手法を解説しました。

AIエージェントは、自動的にインプット・アウトプットを行うことから、一般のシステムよりも、他者に損害を与える可能性は高くなるといえ、そのような場合に誰がどのような責任を負うかが問題となります。

このような問題に関して、経済産業省の「AI利活用における民事責任の在り方に関する研究会」[i]において、AIを利用した場合の利用者、開発者、提供者の責任について議論されており、「AI利活用における民事責任の解釈適用に関する手引き(案)」(以下「手引き案」といいます。)がパブリックコメントに付されています。[ii]

手引き案では、大きく分けて、①AI利用者の判断の補助・支援としてのみ用いられ、最終的に人の判断や行動を介在させることが予定されている類型(以下「補助・支援型」といいます。)、②人の判断や行動の全部又は一部を代替する前提で提供され、AIの判断に依拠しながら用いることが予定される類型(以下「依拠・代替型」といいます。)に分けて、民事責任に関する解釈を整理しています。[iii]

AIエージェントは、業務プロセスのどの部分を自動化できるかによって、①にも②にもなり得るものです。[iv]手引き案では、AIエージェントについて、個別技術やユースケースに強く依存するため、当事者の責任を個別具体的に整理することは現時点では困難であるものの、手引き案で整理した基本的な考え方は、AIエージェント等の高度なシステムを検討する際にも基礎として位置付け得ると指摘されています。[v]このように、AIエージェントについても、AIの利用及び開発・提供に関する民事責任の考え方を整理しておくことは有用であると考えられます。

そこで、本ブログでは、まずは、①補助・支援型について、筆者の裁判官・訴訟代理人としての経験も踏まえつつ、手引き案で紹介されている裁判例も参照しながら、AI利用者及びAI開発者・提供者に関する民事責任について検討します。

本ブログの要点

- 訴訟で問われるのは、当時の判断や対応の合理性である

訴訟では、事後的に見て何をすべきだったかではなく、その当時の状況を前提として何をすべきであったかが問われます。その際、裁判官は、法的な構成だけでなく、当時どのような判断が行われていたかという生の事実にも着目します。したがって、AIに関する民事責任の検討においても、各時点における判断や対応の合理性が重要となります。 - 過失が問題とならないよう、事前に対応を検討しておくことが重要である

AI利用者及びAI開発者・提供者のいずれにとっても、前方視野に基づき、AIの利用及び開発・提供に関する検討プロセスを明確化し、検討結果に応じた体制を整備しておくことが重要です。手引き案は、補助・支援型において、AI開発者・提供者について因果関係が原則否定されるとしているものの、訴訟実務を踏まえると、それによって直ちに法的リスクへの備えが不要になるわけではありません。このような対応は、第5回(前回)のブログで説明したAIガバナンスの考え方と整合します。

民事責任の基本的な考え方

(1) 検討の要点

手引き案において指摘されているとおり、AI利活用に伴って他者に損害を与えた場合には、既存の民事責任に関するルールが適用されますが、このような場合についての裁判例の蓄積や統一的な見解はありません。[vi]

ただし、民事責任に関する判断は、具体的な事実に対して法を適用するものですから、本質的にケース・バイ・ケースの判断にならざるを得ませんし、AI以外の民事責任でも、統一的な見解があるものは決して多くはありません。

その一方、民事責任の主な根拠となる債務不履行責任及び不法行為責任については、非常に多くの裁判例、議論の蓄積があり、これらを踏まえれば、民事責任について全く予測ができないものでもありません。

民事責任を考える上では、どのようなAIを、どのように開発・提供・利用するかという具体的な事実関係を明らかにした上で、民事責任についての基本的な理解を踏まえて検討することが重要になると考えられます。

(2) 民事責任の根拠・要件

前述のとおり、民事責任の主な根拠となるのは債務不履行責任又は不法行為責任です。

債務不履行責任は、基本的に契約関係にある当事者間で生じる責任であるのに対し、不法行為責任は、契約関係がない当事者間でも生じる責任です。手引き案では、不法行為責任を中心に検討が行われています。[vii]

本ブログでも、不法行為責任を中心に検討しますので、不法行為責任の要件について整理します。

不法行為責任については、さまざまな議論があるところですが、以下の要件に整理できます(民法709条)。

|

① 権利又は保護法益に対する侵害行為 |

訴訟では、各要件について具体的に特定して主張立証することが必要になります。例えば、AIの利用に関連して、第三者が損害を受けた場合に、②の要件について、単に「過失があった」と主張するだけでは足りず、特定の時点で、特定の行為を行うべき注意義務があり、その義務を怠ったことを主張立証する必要があります。

過失については、あくまでも、特定の時点において、その当時の状況を前提として、何をすべきであったかが問われるため、「後知恵」で何をすべきであったかが問われるわけではありません。特にAIに関しては技術・環境の変化が非常に速いため、後から見れば不適切な対応だったということが起こり得ると思いますが、当時の状況において不適切といえなければ、過失にはなりません。

なお、債務不履行責任についても、同様に、債務の存在などが要件として必要となりますが、当事者間において、どのような債務が存在していたかを具体的に特定して主張立証する必要があります。具体的なケースを想定すると、AIの利用に関連して、契約相手が損害を受けた場合に、「契約相手に損害を与えさせないようにする債務」と抽象的に主張するだけでは足りず、「AIの利用時に○○を行うべき債務」などと具体的に特定して主張立証する必要があります。

(3) 過失の事実上の推定

手引き案は、AIの文脈にそのまま適用し得るものではないと前置きしつつも、医療過誤訴訟や環境訴訟等における専門技術性や証拠の偏在といった特徴はAIにも妥当する場合があることから、重大な法益侵害等の正当化根拠があれば、過失を事実上推定することを検討すべき場合もあり得ると指摘しています。[viii]

過失の事実上の推定については、①訴訟手続上の留意点、②法解釈上の問題があるように思われます。

まず、①訴訟手続上の留意点として、過失の事実上の推定は、訴訟の初期段階ではなく、過失をどのように判断すべきかという訴訟の最終局面で問題となるものです。医療過誤訴訟においても、実際の審理では、まずは原告(患者側)が過失(注意義務違反)を十分に特定し、過失及び因果関係を基礎付ける医学的知見の主張立証が求められることが一般的であり[ix]、一般の不法行為訴訟でも、そのような訴訟進行がされていると理解しています。AIの事案でも、まずは、原告が過失を特定し、過失を根拠付ける事実を主張立証する必要があると考えられます。

また、②法解釈上の問題としては、医療過誤訴訟や環境訴訟等においても、過失の事実上の推定が行われるような事案は限定的です。手引き案で引用されている判例についても、添付文書の記載が明確だった事例(2分間隔で血圧測定をすべきと記載されていたもの)であり[x]、判例の射程を限定的に解すべきとの指摘もあります。[xi]AIの事案について考えてみると、さまざまなAIが想定され、さまざまなプレーヤーがいる中で、そもそも医療訴訟のような専門家としての医師に法的に要求される一定の水準(医療水準)というものを見出し難いように思われ、個別具体的なAIについて過失を推定すべきような事情は直ちに思い付きません。一般論として過失の事実上の推定があり得ることは否定できないものの、相当に例外的な事例に限られるように思われます。

補助・支援の類型における民事責任

(1) 考えられる請求

どのような請求があり得るかを考える際には、①当事者、②請求の根拠で整理することが一般的です。

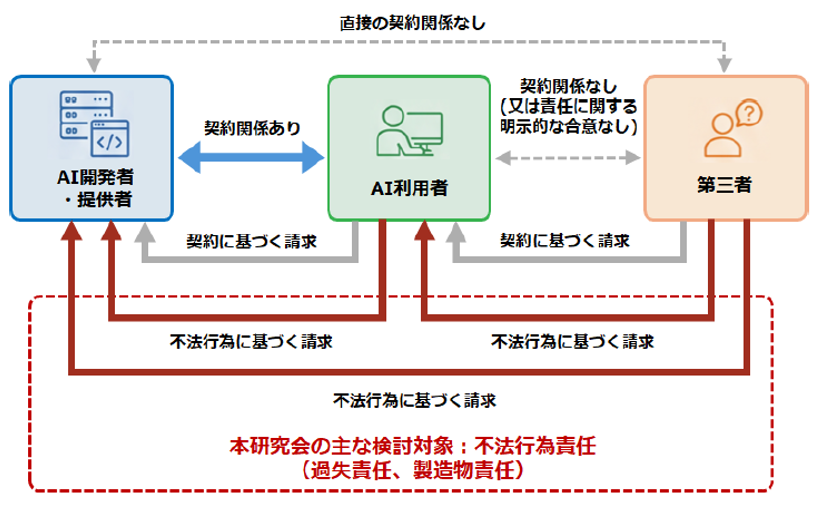

手引き案において、以下の図のとおり、整理されているように、①当事者の観点では、第三者と利用者、第三者と開発者・提供者、利用者と開発者・提供者の3通りが考えられます。②請求の根拠では、当事者間において直接の契約関係がある場合には、まず契約責任(債務不履行責任)が考えられますが、不法行為責任も排除されません。また、当事者間において直接の契約関係がない場合には、不法行為責任が考えられます。

(手引き案7頁から引用)

(2) 手引き案における整理

手引き案では、現状では多くのAIが補助・支援型に該当すると考えられるとした上で、補助・支援型のケースについて、AI利用者とAI開発者・提供者の不法行為責任を、以下のように整理しています。[Xii]

AI利用者については、あくまで自らの判断の補助や支援としてAIを用いるべきであり、従来の過失の判断枠組みの下、一般的には、AIの出力を踏まえつつ正確性や適切性を評価しながらAIを用いることが求められるとされています(後記の想定事例1及び想定事例2)。[Xiii]また、AIの出力について、一見するだけではリスクの所在が不明瞭で、検証・是正が容易ではない場合には、第三者に対する権利侵害や損害の発生を防止するために、事前の情報収集や必要な利用上の措置を講ずることが求められ得るとされています(後記の想定事例3及び想定事例4)。[Xiv]

AI開発者・提供者については、AIが不適切な出力をした場合でも、最終的にAI利用者においてAIの出力の適切性が検証・是正されることが前提となるため、原則として因果関係が否定され、第三者との関係で責任を負う場面は限定的であるとされています。[xv]その上で、AIの機能や性能の限界、使用方法、重要なリスク等について明確な説明を行っている限り、AI開発者・提供者には原則として過失も認められないとされています。[xvi]また、AI利用者がリスクを具体的に予見したり、出力をコントロールしながら用いたりすることが必ずしも容易でない場合には、一定の権利侵害防止措置等を講ずることが問題となる可能性が指摘されています(後記の想定事例3及び想定事例4)。[xvii]

手引き案では、補助・支援型のAIについて、以下の想定事例を題材として、AI利用者及びAI開発者・提供者の責任について検討がされています。[xviii]

想定事例1:配送ルート最適化AI

想定事例2:弁護士業務支援AI

想定事例3:画像生成AI

想定事例4:取引審査AI

各想定事例においては、それぞれのAIの特性に応じた議論が展開されており、具体的な事例を検討する上で重要な示唆が含まれていますが、本ブログでは、まずは、個別の想定事例の検討に立ち入るのではなく、補助・支援型における民事責任について全体的な視点から検討を行います。

(3) 手引き案の整理についての検討

手引き案は、補助・支援型について、AI利用者及びAI開発者・提供者のそれぞれの責任を整理しています。以下では、手引き案の整理について、利用者と開発者・提供者のそれぞれの視点から検討します。

ア 補助・支援型の実質的根拠と類型の境界

手引き案は、AIが補助・支援型に該当する実質的な根拠として、①AIの機能や利用される場面を踏まえると人の判断を代わりに行っているとはいえないこと(ケース)、②規制法上の理由により人の最終的な判断が要求されること(ケース)、③AIの出力内容が潜在的に第三者の権利を侵害するリスクを内包しており、この点について人の評価や検証が必要であること(ケース)を挙げています。[xix]

このうち、②については、規制法上の要請であるため、該当性は比較的明確です。他方で、①と③については、それぞれの要素が必ずしも排他的ではありません。例えば、取引審査AIのように、AIの利用される場面を踏まえると人の判断を代わりに行っているとはいえないものであり(①)、かつ、出力内容が潜在的に第三者の権利侵害リスクを内包している場合(③)もあり得ます。

そのため、上記のいずれのケースに該当するかという分類自体から、取るべき対応が一義的に導かれるわけではなく、AI利用者としては、利用するAIの具体的な機能や性質を踏まえて、どのようなリスクが想定され、それに対してどのような措置を講じるべきかを個別に検討することが求められると考えられます。

イ AI利用者の過失

手引き案の整理によれば、補助・支援型のAI利用者については、AIの出力を踏まえつつ正確性や適切性を評価しながらAIを用いることが求められるとされています。この整理自体は、補助・支援型の性質上、妥当であると考えられます。

もっとも、利用者としては、客観的には補助・支援型として使うべきであったAIを、人間の検証を省略して依拠・代替型として使っていたような場合も考えられます。このような場合に、過失がどのように整理されるかも問題となります。

そこで検討すると、まず、具体的なケースでは、依拠・代替型として使うという判断の誤り自体によって第三者に損害を発生させたのか否か(補助・支援型として使っていたとしても避けられなかったか)が必ずしも特定できない場合もあると考えられます。また、AIをどのような使い方で用いるかの判断は、AIの機能・性能、利用される業務の性質、利用時点で入手可能な情報等を踏まえた総合的な判断であり、その判断の時点で合理的な検討を行っていたのであれば、事後的に見て類型選択が最適でなかったとしても、それ自体を注意義務違反と評価することは困難な場合もあると考えられます。

そうすると、具体的な事実関係に応じて、その使い方を選択した上で、選択した使い方に応じた適切な体制を構築していたかという点が問題になると考えられます。例えば、依拠・代替型として用いると判断したのであれば、AIに判断を委ねることの合理性を裏付ける検証を行い、誤出力等を防ぐ対応体制を構築していたかが問われることになると考えられます。この点は、次章で述べる前方視野的な対応においても重要な視点となります。

ウ AI開発者・提供者の責任 ― 因果関係と過失

前記(2)で述べたとおり、手引き案は、補助・支援型におけるAI開発者・提供者の責任について、因果関係と過失の両面から整理しています。

このうち、因果関係に関する整理については、手引き案の引用する文献や裁判例の射程を踏まえると、以下のとおり、慎重な検討を要する点があると考えられます。

まず、手引き案は、「権利侵害との関係で他人の判断が介在した場合、直接の原因となったのは当該他人の意思決定であることを理由に、原則として因果関係が否定されると考えられてきた」として、文献を引用しています。[xx]

しかし、当該文献の記述は、「人の意思決定が介在した因果関係」と「違法な意思決定が介在した場合」とを分けて、後者の場合(他人が「自由意思によって違法な行為を決意した場合」)に因果関係が否定されるというものであり[xxi]、広く他人の判断が介在すれば因果関係が否定されるという趣旨ではないと考えられます。一般的に他者の判断の介在が直ちに因果関係の否定を意味するとまではいえません。[xxii]

さらに、手引き案は、因果関係が否定された裁判例として、福島地判平成30年12月4日判時2411号78頁を引用しています。[xxiii]しかし、この判決は、具体的な事実関係に基づく事例判断の要素が強いものです。その上で、日本法においては下級審判決に先例拘束性がないことも踏まえると、同判決の射程は限定的であると考えられます。

加えて、実際の裁判実務において、判決で、因果関係のみで責任を否定し、過失の判断に踏み込まないことは必ずしも多くなく、過失と因果関係の両方が審理判断されることの方が多いように思われます。その上、少なくとも当事者が判断対象を因果関係のみにコントロールすることはできません。その意味でも、因果関係のみを判断して責任を否定した上記裁判例について、一般化することは難しいといえます。

そうすると、AI開発者・提供者としては、AI利用者の「判断の介在」をもって因果関係が否定されるという点を重視することには慎重になるべきであり、むしろ後記5で述べるような過失が否定されるための対応を重視すべきであると考えられます。

民事責任を踏まえた対応

(1) 訴訟における後方視野と前方視野

訴訟においては、前記3(2)で述べたとおり、過失については、あくまでも、特定の時点において、その当時の状況を前提として、何をすべきであったかが問われるものの、その分析自体は、事後的に行われるものです。

他方で、AIエージェントを開発・提供し、利用する段階では、前方視野的な発想に基づいて対応を検討する必要があります。

手引き案においても、例えば、AI開発者・提供者の過失に関する整理において、AIの機能や性能の限界、使用方法、重要なリスク等について明確な説明を行っている限り、原則として過失は認められないとしており[xxiv]、これは過失が否定され得る事情を示しているものといえます。また、AI事業者ガイドラインへの適合や不適合が直ちに過失の有無に結びつくわけではないものの、同ガイドラインの考え方を踏まえたリスクの調査・分析や体制構築を行っていた場合に、過失の判断において有利に斟酌される可能性も述べられています。[xxv]さらに、各想定事例においても、AI事業者ガイドライン上想定される措置を当事者ごとに整理した記載がある[xxvi]など、事前に講じるべき措置に関する示唆も含まれています。

本ブログでは、こうした手引き案の示唆も踏まえつつ、AI利用者及びAI開発者・提供者のそれぞれの立場から、前方視野的な対応の要点を整理することを試みます。

(2) 2類型の整理と前方視野的な課題

手引き案は、補助・支援型と依拠・代替型の2類型に分けて、それぞれの類型ごとに民事責任の基本的な枠組みを整理しています。その上で、依拠・代替型に該当するためには、当該AIに「判断を委ねることが合理的といえる」ことが要件となり、実際の事案ではこの点が争点となることが見込まれるとされています。[xxvii]

確かに「判断を委ねることが合理的といえる」か否かは中心的な争点になると考えられるものの、前記4(3)で述べたとおり、類型選択自体が直ちに注意義務違反を構成しない場合もあり得るため、単純に判断を委ねたか否かだけが問題になるような事案は必ずしも多くないように思われます。そうすると、どのような事実関係の下で、どのような体制を構築していたかという事情が総合的に考慮されて過失が判断されることになると考えられ、選択に応じた適切な体制を構築していたかも問われることになると考えられます。

特に、AIエージェントにおいては、業務プロセスの中で補助的に用いられる場面と、実質的に判断を委ねている場面が混在し得るものであり、単純化することは困難であるため、タスクの内容や業務プロセスの段階に応じて具体的に検討する必要があります。

(3) 前方視野的な対応の要点

ア 共通する視点

訴訟では、主張と証拠が両輪となって審理が行われ、最終的な判断に至ります。過失についての審理でいえば、特定の時点において、その当時の状況を前提として、何をすべきであったかについて主張が交わされて、その前提となる事実関係について証拠に基づいて立証が行われることになります。その際に、裁判官は、法的な構成はもちろんですが、その当時、AIの開発者・提供者・利用者において、どのような判断が行われていたかという生の事実にも着目します。そこで、開発者・提供者・利用者においては、当時の判断について十分な説明ができ、かつ、その合理性を示す必要があります。

そうすると、AI利用者及びAI開発者・提供者のいずれの立場においても、前方視野的な対応において、事後的に過失がないと評価されるために、自己の判断を整理し、書面化して準備を行うべきです。これは、第5回のブログで述べたAIガバナンスの考え方とも共通する面があり、技術、法務、ビジネス部門の協働によるリスク評価、モニタリング、インシデント対応の体制を構築していくことが考えられます。過失の有無は、「その時点で、何を知り得たか」「どのような対応をすべきであったか」という前方視野的な視点から判断されるものであり、これに対する回答を事前に準備しておくことが、結果として過失が否定される方向に働くと考えられます。

なお、訴訟における主張立証構造では、まずは原告(損害を被った第三者)が過失を特定し、当該過失を根拠付ける事実を主張立証しなければなりません。そのため、実際の訴訟において、被告側となるAI利用者及びAI開発者・提供者が現実にどこまで当時の判断を明らかにすべきかはケース・バイ・ケースになると考えられますが、上記準備を行うこと自体を否定することにはなりません。

イ AI利用者の視点

AI利用者は、自らの意思で使い方を選択できる一方で、AIの機能・性能の限界を完全に把握することは容易ではありません。そのため、自らは依拠・代替型として使っているつもりであっても、事後的に見ると客観的には補助・支援型であると評価されるリスクがあります。

そこで、AI利用者としては、自社の事業の性質や規模を踏まえた上で、以下の対応が重要になると考えられます。

まず、AIエージェントであれば、どの業務プロセスにおいて、どのような使い方をするかを検討し、その検討プロセスを明確にし、業務プロセスごとに整理しておくことが求められます。

また、検討において前提とした事実(AIの機能・性能に関する開発者・提供者からの説明内容、業務の性質、想定されるリスク等)を書面で記録しておくことです。

さらに、選択した使い方に応じた検証体制を整備しておくことです。補助・支援型として用いるのであれば、AIの出力を人間が実効的に検証できる体制が構築されているかが問われることになります。

ウ AI開発者・提供者の視点

AI開発者・提供者は、自らのAIがどのように利用されるかを完全にはコントロールすることができません。補助・支援型として想定して開発・提供したAIが、利用者において依拠・代替型として使われる場合もあり得ます。

このような事情を踏まえると、AI開発者・提供者としては、自社の事業の性質や規模を踏まえた上で、以下の対応が重要になると考えられます。

まず、AIの機能・性能の限界、利用上のリスクについて明確な説明を行うことです。この点は、前記4(2)のとおり、手引き案で整理されているように、過失の有無の判断においても重要な考慮要素になると考えられます。

また、利用者が想定と異なる使い方をした場合も視野に入れた対応を検討しておくことも重要になります。例えば、利用規約における利用条件の明確化(上記の明確な説明にも重なります)、技術的なガードレールの設計、出力に対する注意喚起の表示等が考えられます。

まとめ

本ブログでは、手引き案の整理を踏まえ、補助・支援の類型におけるAIの民事責任について検討しました。

AI開発者・提供者及びAI利用者のいずれにとっても、過失が否定されるための対応を事前に検討しておくことが重要です。その際には、AIの使い方の検討プロセスを明確にし、各時点での判断や対応の合理性を説明できるようにしておくことがポイントになると考えます。

次回は、民事責任②として、依拠・代替の類型について検討したいと思います。

以上

[i] 経済産業省「AI利活用における民事責任の在り方に関する研究会」、(https://www.meti.go.jp/shingikai/mono_info_service/ai_utilization_civil/index.html, 2026年3月8日最終閲覧)。

[ii] E-GOVパブリック・コメント「「AI利活用における民事責任の解釈適用に関する手引き(案)」に対する意見公募」(https://public-comment.e-gov.go.jp/pcm/detail?CLASSNAME=PCMMSTDETAIL&id=595226004&Mode=0, 2026年3月8日最終閲覧)。

[iii] 経済産業省「AI利活用における民事責任の解釈適用に関する手引き〔第1.0版〕(案)」11頁(https://public-comment.e-gov.go.jp/pcm/download?seqNo=0000307821, 2026年3月8日最終閲覧)。

[iv] AIエージェントが行うタスクが複雑化すればするほど、第三者との接点という視点でも、単純に①と②で切り分けられるものではなくなり、①の場面もあれば、②の場面もあることも想定されるため、どのような場合にどのような責任が生じるかについて、個別具体的に検討する必要があります。

[v] 経済産業省・前掲注iii)69頁。

[vi] 経済産業省・前掲注iii)4頁。

[vii] 手引き案では製造物責任法についても検討が行われていますが、主として依拠・代替型で問題となるため、次回以降で検討します。

[viii] 経済産業省・前掲注iii)72-76頁。この問題については、別の機会にも検討したいと思います。

[ix] 山川勇人「医療訴訟における迅速・計画審理の取組について」判タ1520号14頁、15頁。

[x] 最判平成8年1月23日民集50巻1号1頁。

[xi] 大島眞一「医療訴訟の現状と将来―最高裁判例の到達点―」判タ1401号5頁、16-17頁。

[xii] 経済産業省・前掲注iii)11、20頁。

[xiii] 経済産業省・前掲注iii)12、20頁。

[xiv] 経済産業省・前掲注iii)12、20頁。

[xv] 経済産業省・前掲注iii)12-13頁。

[xvi] 経済産業省・前掲注iii)13頁。

[xvii] 経済産業省・前掲注iii)13頁。

[xviii] 経済産業省・前掲注iii)20-47頁。

[xix] 経済産業省・前掲注iii)11頁。

[xx] 経済産業省・前掲注iii)12頁。

[xxi] 窪田充見編『新注釈民法(15) 債権(8)〔第2版〕』387-388頁〔橋本佳幸〕(有斐閣、2024年)。

[xxii] 例えば、単純に並列して論じることはできませんが、いじめ自殺訴訟においては、被害者自身の自死の決断という「他人の判断」が介在していますが、いじめ行為と死亡との因果関係が肯定される裁判例が存在します。いじめ自殺訴訟の裁判例を分析したものとして、横田昌紀「児童生徒のいじめ自殺訴訟の現状─因果関係を中心に」判タ1358号4頁。

[xxiii] 経済産業省・前掲注iii)12-13頁。

[xxiv] 経済産業省・前掲注iii)13頁。

[xxv] 経済産業省・前掲注iii)10-11頁。

[xxvi] 経済産業省・前掲注iii)35、47頁。

[xxvii] 経済産業省・前掲注iii)15頁。

Member

PROFILE